Kaikki tähän tarvittavat työkalut ovat julkisesti saatavilla ja helppokäyttöisiä, myös harrastajille. Kaikenlaisia elokuvanäkymiä voidaan manipuloida ja näyttelijöiden kasvot vaihtaa. Reddit-käyttäjä loi sen avulla Rogue Onen Leia-kohtauksen ilman 200 miljoonan dollarin budjettia. Teknologialla voi olla vakavia seurauksia.

Sen jälkeen kun yksi Redditor aiheutti sensaation kaksi kuukautta sitten petollisesti todellisilla pornoväärennöksillä Gal Gadotista ja muista tähdistä ja tähdistä, Redditiin ilmestyi koko kohtaus. Subreddit r / syväväärennökset on nyt yli 38 000 jäsentä, joista monet manipuloivat pornoa itseään käyttämällä tekoälyä kasvojen asettamiseksi olemassa olevaan elokuvaan. He tarvitsevat vain tarpeeksi kuvia heidän epäilemättömästä kohteestaan ja muutamia julkisesti saatavilla olevia työkaluja. Redditor teki jopa sovelluksen, jota jopa aloittelijat voivat käyttää tekoälypohjaisen pornon luomiseen.

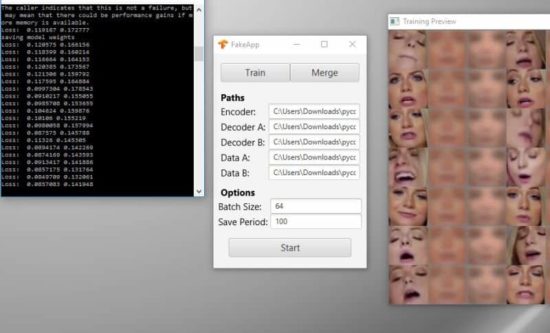

Redditor deepfakeapp kehitti ns Fake App, helppokäyttöinen sovellus, jonka avulla kuka tahansa voi manipuloida pornoa. "Uskon, että sovelluksen nykyinen versio on hyvä lähtökohta, mutta toivon voivani parantaa sitä entisestään tulevina päivinä ja kuukausina", hän sanoi. "Haluan, että käyttäjät voivat yksinkertaisesti valita videon tietokoneeltaan, ladata hermoverkon, jolle syötetään tietty joukko kuvatietoja julkisesta arkistosta, ja sitten vaihtaa videon kasvot napin painalluksella. "

Esimerkiksi Redditor UnobtrusiveBot asetti Jessica Alban kasvot pornonäyttelijä Melanie Riosin vartalolle FakeAppilla. "Se oli supernopea - opettelen vain kouluttamaan mallia uudelleen. Kesti noin viisi tuntia - ei paha tuloksen kannalta", hän kirjoitti kommentissa. Redditor nuttynutter6969 käytti myös FakeAppia tehdäkseen Star Wars -näyttelijästä Daisy Ridleystä tahattomaksi pornotähdeksi.

Suurin osa r / deepfakes-viesteistä on luonteeltaan pornografista, mutta jotkut käyttäjät luovat myös videoita, jotka todistavat, että tekniikalla ei ole rajoja, jos sinulla on vain oikeat raakatiedot. Esimerkiksi Redditor Z3ROCOOL22 yhdisti Hitlerin äänitteet Argentiinan presidentin Mauricio Macrin kanssa. Voimakkaasti deepfakeapp kuka tahansa, joka lataa FakeAppin ja jolla on yksi tai kaksi korkealaatuista videota kohdehenkilöstään, voi luoda realistisia elokuvia.

Tarvitset vain hyvän grafiikkaprosessorin, jossa on CUDA-tuki. Käyttäjät, joilla ei ole oikeaa prosessoria, voivat käyttää myös pilvipohjaisia palveluita, kuten Google Cloud Platform. Koko prosessi datan purkamisesta muuntamiseen koko kasvojen vaihdoksi kestää oletettavasti noin kahdeksan - kaksitoista tuntia, jos se tehdään oikein. Jotkut käyttäjät ilmoittavat, että se kesti paljon kauemmin - joskus tuhoisilla tuloksilla.

Deepfakeapp mainitsee erityisen onnistuneen esimerkin Video käyttäjän derpfake-sovelluksestajoka loi Prinsessa Leian kasvojenvaihdon Rogue Onesta. "Yllä on alkuperäinen Rogue Onesta, jossa on outo tietokoneanimaatio Carrie Fisher. Elokuvan budjetti: 200 miljoonaa dollaria», derpfake kuvaa hänen videoitaan. "Alla on 20 minuutin manipulointi, joka olisi voitu tehdä näyttelijälle, joka näyttää Carrie Fisheriltä. Budjettini: 0 dollaria ja pari Fleetwood Mac -albumia." Sen sijaan, että olisi animoinut prinsessa Leian kasvot suurella kustannuksella tietokoneella, derpfake oli syöttänyt ohjelmistoon oikeita kuvia nuoresta Carrie Fisheristä ja lisännyt ne elokuvan kohtauksiin.

Teknologialla, joka tekee petollisten oikeiden videoiden väärentämisestä niin helppoa ja kehittyy niin nopeasti, voi olla vakavia vaikutuksia. Mielikuvituksella ei ole rajoja: riippumatta siitä, koskeeko se kosto-pornoa, manipuloituja tähtien tallenteita vai poliittisia puheita, tarvittavilla raakatiedoilla ja muutamalla avoimen lähdekoodin työkalulla, jokainen äänitys voidaan väärentää. Pian tekniikka on niin hyvä, että on mahdotonta erottaa todellinen video ja tekoälyn tuottama väärennös. Vielä nykyäänkin ihmisten on yhä vaikeampaa erottaa totuus ja väärennetyt uutiset, ja kaikenlaiset uutiset leviävät nopeasti sosiaalisen median kautta. Uutta on, että tekniset keinot ovat nyt kaikkien saatavilla. Tämä tukee koko luottamuksen ja uskottavuuden periaatetta. Meidän on todennäköisesti totuttava maailmaan, jossa tällaiset videoväärennökset ovat paranemassa ja siksi vaikeampaa tunnistaa. Mukaan lukien ristiriidat asianomaisten henkilöiden oikeuksien kanssa. Tulevaisuudessa tällaista väärentämistä voitaisiin käyttää perustana propagandalle tai tarkoituksellisesti harhaanjohtaville uutisille.

"Dravens Tales from the Crypt" on lumoinut jo yli 15 vuoden ajan mauttomalla sekoituksella huumoria, vakavaa journalismia - ajankohtaisista tapahtumista ja epätasapainoista uutisointia lehdistöpolitiikassa - ja zombeja, koristeltu paljon taidetta, viihdettä ja punk rockia. Draven on muuttanut harrastuksensa suosituksi brändiksi, jota ei voi luokitella.

"Dravens Tales from the Crypt" on lumoinut jo yli 15 vuoden ajan mauttomalla sekoituksella huumoria, vakavaa journalismia - ajankohtaisista tapahtumista ja epätasapainoista uutisointia lehdistöpolitiikassa - ja zombeja, koristeltu paljon taidetta, viihdettä ja punk rockia. Draven on muuttanut harrastuksensa suosituksi brändiksi, jota ei voi luokitella.